AI分野で欠かせないGPUとは?CPUとの違いや活用例まで解説

........

- 更新日

- 公開日

- 2025.08.27

近年、ChatGPTをはじめとする生成AI技術が急速に発展し、注目を集めています。AIという言葉は以前より頻繁に耳にするようになりましたが、「実際にAIとは何をする技術なのか?」、「AIにはGPUが必要と言われているが、本当に必要なのか?」と疑問を抱いている方も多いのではないでしょうか。

1. GPUとは?

GPUはGraphics Processing Unit(グラフィック処理装置)の略で、リアルタイムに画像処理をするためのICです。現在はGPGPU(General-Purpose computing on GPU)によりAIなどでも活用されています。

本章では、そんなGPUの構造と歴史、CPUとの違いに関して説明します。

1. GPUの構造と歴史

当初のGPUは専用の描画処理HW(頂点処理、ラスタ化処理※1、フラグメント処理※2など)をパイプライン化したグラフィックスパイプラインで構成されていましたが、2Dグラフィックスから3Dグラフィックスへの移行など、GPUで処理する演算内容の変化に伴い内部構造も変化していきました。現在では、各描画処理をプログラム化し、各処理を実行するための演算ユニットを多数設けることで、各描画処理を同時に大量実行できるような構成になっています。描画という大量のデータを扱う関係上、高速のビデオメモリ(VRAM)と接続されており、演算ユニットとVRAM間で大量のデータを高速にやり取りできるということもGPUの特徴と言えます。

ゲームにおける描画性能などは、これらの演算ユニット数、VRAM容量/バス帯域、処理速度(クロック周波数)と演算ユニット自体の処理性能などに支えられており、今も飛躍的に進化しています。

GPUの構造変化に伴い、GPU内の演算ユニットにCPUで行っていた汎用的な演算処理を行わせるGPGPUも注目されてきました。多量の演算ユニットによる高速並列処理とVRAMによる大量データの取り扱いがGPGPUの強みと言えます。GPUベンダのNVIDIAはGPGPUをより使いやすくするためにC言語ライクにGPGPU処理を記述可能なCUDAを開発し、ディープラーニングや仮想通貨マイニングなどに活用されました。現在ではAIの発展を支える技術となっています。(GPGPUの詳細は「4. 並列処理による高速化とは?」で説明します。)

- 1 : ベクターデータ(線や曲線による画像データ)からラスタデータ(画素/ピクセルの集合)に変換する処理

- 2: ラスタ化されたピクセル(フラグメント)の色を計算する処理

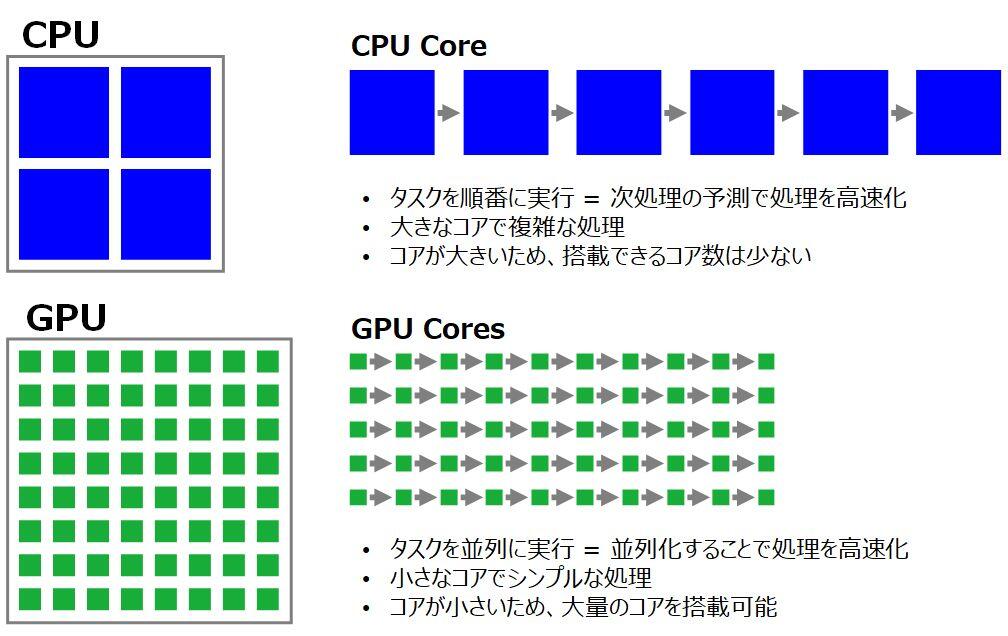

2. CPUとGPUの違い

コンピュータの処理を担う主要な部品として、真っ先に思いつくのはCPU(Central Processing Unit:中央演算装置)です。CPUは一般的な計算処理を担い、パソコンやスマートフォンなどあらゆるデバイスに搭載されています。ではCPUとGPUではどのように違うのでしょうか?それぞれの特徴を比較してみましょう。

| CPU | GPU | |

|---|---|---|

| 処理方式 | 逐次処理(1つずつ順番に計算) | 並列処理(多数の計算を同時に実行) |

| コア数 | 数コア(高性能な大規模コア) | 数千の小規模コア(大量の計算を同時処理) |

| 得意分野 | 複雑な計算を順番に実行すること | 大規模なデータを並列に処理すること |

| AIへの適性 | 小規模なAIモデルの推論に向いている | 大規模なAIモデルの推論に最適 |

| コスト | GPUより安価な場合が多い | 高価だが、性能とコストのバランスが良い |

このように、CPUとGPUは異なる役割を持ち、得意な処理も異なります。これらの違いにより、GPUはAIの推論処理に適していると言われています。次章では、その理由を詳しく見ていきましょう。

- 全てのAI推論がGPUを必要とするわけではありません。タスクの規模や処理負荷により、CPUでも十分に対応できるケースがあります。この点については「5. まとめ」で触れます。

2. GPUのユースケース

GPUはゲームなどで良く見られる2D/3D描画処理、物理演算、レイトレーシングなどで使用されますが、ここではAI推論でGPUが有効に機能する代表的なユースケースを紹介します。

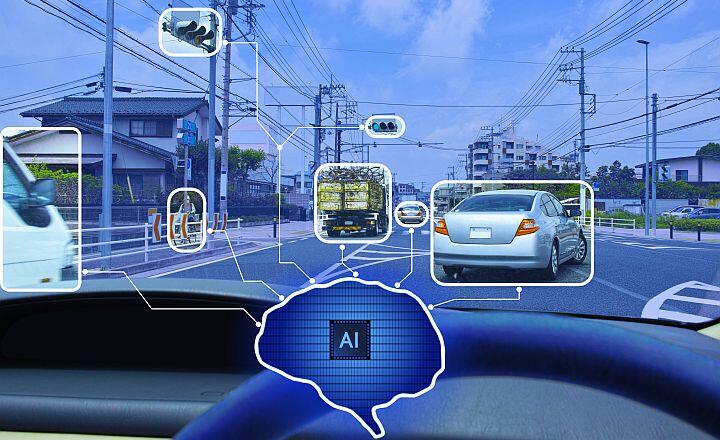

1. 画像認識

画像認識は、大量のピクセルデータを処理し、そこから特徴を抽出して分類や検出を行うタスクです。GPUの並列処理能力を活かすことで、リアルタイムでの高精度な推論が可能になります。

✅ ユースケース

- 自動運転における物体認識(例:車両や歩行者の検出)

- 工場の製品検査

- 医療画像診断(例:CTスキャンやMRIの解析)

2. 音声認識

音声認識は、音声データをテキスト化する技術であり、これも大量のデータを並列に処理する必要があります。GPUを用いることで、高速かつ高精度な音声認識が実現できます。

✅ ユースケース

- 音声アシスタント

(例:スマートスピーカのリアルタイム音声認識) - 工場の製品検査

- 会話のリアルタイム文字起こし

3. 自然言語処理

自然言語処理(NLP:Natural Language Processing)は、人間の言葉を理解・生成するAI技術です。GPUは、このようなモデルの推論を高速に実行するための重要な役割を担っています。

✅ ユースケース

- チャットボット(例:カスタマーサポートの自動応答)

- 翻訳システム(例:リアルタイム翻訳アプリ)

3. AIの推論にGPUが適している理由

AIの推論、特にニューラルネットワークの推論処理は膨大な数の演算を必要とし、CPUでは処理が追いつかない場合があります。GPUは、多数のコアを用いてAIの計算処理を並列に実行できるため、CPUに比べて高速に処理を行えます。

例えば、カメラの映像から物体を識別したり、音声データから言葉を認識するAIの推論処理では、ニューラルネットワークが莫大な計算を一度に実行する必要があるため、GPUを活用した並列処理によって、CPUの逐次処理よりも大幅な処理速度の向上が期待できます。

✅ 逐次処理と並列処理の違い

次章では並列処理の詳細について説明します。

4. 並列処理による高速化とは?

たとえば、画像をAIが見て何が写っているか判断する時、

- 画像の中のピクセルを数値に変換

- その数値に対して「重み」をかける(行列演算や畳み込み演算)

- 結果をまとめて次の処理に渡す

…というように、大量の計算を一気に処理する必要があります。

この計算を並列処理で高速化するためには、GPGPUという技術があります。

GPGPUとは?

“General-Purpose computing on Graphics Processing Units” の略で、もともとグラフィックス処理用だったGPUを、AI推論や科学技術計算などの一般的な計算処理に活用する技術です。

その中でも、NVIDIAが提供するCUDAという開発プラットフォームがあります。これはGPUの演算能力を効率的に引き出すためのツールで、行列演算や畳み込みといったAIに必要な処理を高速に実行できます。

PyTorchやTensorFlowなどの主要なAIライブラリでも内部的にCUDAが使われており、ユーザーは複雑な並列処理を意識せずに、高性能なAI処理を簡単なコードで実現できます。

ちなみに、OpenCLという汎用的な並列処理の仕組みもあり、NVIDIA以外のGPUやFPGAでも動作します。ただし、AI用途ではCUDAの方が高速で、開発ツールも充実しているため、現在ではOpenCLが使われるケースは少なくなっています。

- 当社グループ会社の菱洋エレクトロでは、主にCUDAに最適化された “Jetsonシリーズ(Jetson AGX Orin、Jetson Orin Nanoなど)” を提供しています。

5. まとめ

本記事では、GPUの基本構造から、その並列処理の仕組み、CPUとの違いや得意な処理領域、さらにはAIや画像処理における活用例まで幅広く紹介しました。

GPUは、その高い並列処理能力により、画像処理やAIなどの大量のデータを一括で処理するタスクに最適です。特にAIの分野では、学習モデルの高速化やリアルタイム推論を可能にし、ソリューションの価値を大きく引き上げる重要な技術要素となっています。

一方で、すべての処理にGPUが適しているわけではなく、制御系や逐次処理のようにCPUが得意とする領域もあります。そのため、GPUとCPUを適切に使い分けることが、システム全体の最適化には欠かせません。

「自分たちの業務にGPUが使えるのか?」「AIを動かすにはどれくらいの性能が必要なのか?」そんな疑問を持った方にとって、本記事がGPU導入・活用の第一歩となれば幸いです。

次のステップとして、以下の記事や資料もあわせてご覧ください。

(執筆者:齋藤 智弘、編集者:木庭 正博)